查詢擴展(Query Fan-Out )介紹:理解 Google AI 搜尋的重要技術

這個 Query Fan-Out(查詢擴展)是很重要的概念,對於我們理解 AI 搜尋、出現在 AI 搜尋上,有很重要的影響。

Google 官方說明搜尋 AI 模式(AI Mode)的描述中,提到了:

「在底層技術應用上,AI 模式採用了我們的查詢擴展(query fan-out)技術,將使用者的一個問題拆解成多個子主題,並同時展開多項查詢。

這讓 Google 搜尋能夠更深入地探索網頁、發掘更多網路資訊,並找到與問題高度相關的優質內容。」

這個 Query Fan-Out(查詢擴展)是很重要的概念,對於我們理解 AI 搜尋、出現在 AI 搜尋上,有很重要的影響。

接下來就來一起了解 Query Fan-Out 是什麼吧!

Query Fan-Out(查詢擴展)是什麼

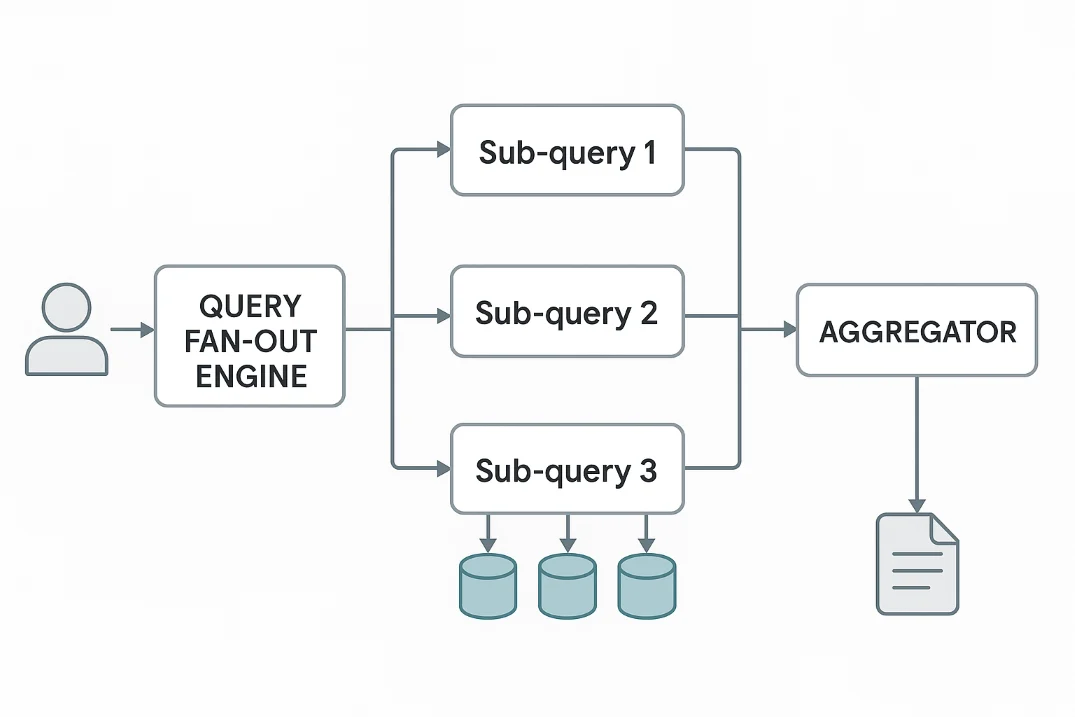

Query Fan-Out 就是把「一條查詢」拆成多條子查詢,同時送往多個資料來源/分片/下游服務,再把回傳結果匯整成一份回應的設計模式

白話文解釋:

一條查詢本來只會問一個地方。而 Fan-Out 就是把這條查詢「分身」成好幾條小查詢,同時去很多地方找,再把結果拼回來,變成一整份回應。

白話文舉例:

想像你生了一場不明原因的大病,主治醫師判斷光靠自己難以一次看出全貌,於是同一上午把你安排到心臟科做心電圖、放射科掃 CT、血液科抽血。

三位專科醫師就像三條平行的查詢路徑,各自在自己的領域迅速蒐集關鍵線索。

下午回到診間,主治醫師把三份檢查報告攤在桌上:這裡的數據顯示血管阻塞風險,那裡的影像又揭露一塊陰影,血液指標則補上發炎程度。只有把這些「碎片」交叉比對、去除重複、填補缺口,才能寫出一份完整的聯合診斷書與治療計畫。

後端系統裡的 Query Fan-Out 也如此運作──多個微服務各自回傳部分 JSON 欄位(風險評分、建議藥物、預估住院天數),必須由 Aggregator 這位「主治醫師」將它們合併成一份最終回應,讓前端一次就拿到全景資訊。

Query Fan-Out 的內涵

拆分意圖:透過 NLP 與 Gemini 模型深入理解原始查詢的多重子意圖。

並行搜尋:同時向多個資料來源(即時網頁、Knowledge Graph、Shopping Graph…)發起多條子查詢。

聚合與摘要:利用大型語言模型,把不同子查詢回傳的片段按「主題/子主題」群組,生成一段有引註的總結內容。這在 Google 最新公開的「Thematic Search」專利裡有被提及。

為什麼 LLM/AI 搜尋幾乎都要做 Query Fan-Out?

核心理由:LLM 要給得出「又廣又準的答案」,就必須先「一次問很多個版本、搜很多個資料庫」,把證據撈到幾乎無可挑剔,才能在後續生成階段減少胡說八道。

在 Google AI Mode 裡,系統會先把「原始提問」拆成數十甚至上百個子查詢,再同步送出。Google 稱這招就是 query fan-out,用來「深入網路,更精準地對應使用者的複雜需求」。

AI 摘要(AI Overviews)和 AI 模式(AI Mode)都可能會使用「查詢擴散傳遞功能」技術,也就是在子主題和資料來源中發出多個相關搜尋,以便產生回覆。在產生回覆時,我們的進階模型會找出更多相關網頁,讓我們顯示與回應相關的更多實用連結 (比傳統網頁搜尋更廣泛多元),讓您探索更多新的可能性。

推薦閱讀:《AI Mode(AI 模式)是什麼?Google AI 搜尋的下一個巨變》

Google 推出視覺搜尋扇出技巧:「Google 的扇出技術能夠將您的問題分解為子主題,並同時為您發出多個查詢。現在,Google 還可以透過查看圖像和文字查詢輸入進行查詢分析以及各種圖像區域分析(包括元資料和圖像周圍的上下文),從而以可視化的方式實現此功能。」

Google:「這意味著 AI Mode 可以對圖像進行更全面的分析,除了主要主體之外,還能識別細微的細節和次要物體,然後在後台運行多個查詢。這有助於它理解完整的視覺環境和自然語言問題的細微差別,從而提供高度相關的視覺結果。」

傳統搜尋的 single-query retrieval(單一查詢檢索)

在傳統(關鍵字式)搜尋流程中,通常採用的是「單一查詢 → 倒排索引檢索 → 排名」的直線式(one-shot)檢索模型,也就是 single-query retrieval 或 monolithic retrieval。

- 使用者輸入一句關鍵字查詢(往往經過簡單同義詞/拼字校正),

- 搜尋系統把這「同一條查詢」同時廣播到各分片索引(shard-level fan-out,但查詢本身不被拆分),

- 各分片返回前 K 條候選文件,再由集中式排序器(merger / reducer)合併、重排,

- 最終輸出前 N 筆結果。

AI 搜尋的「Query Fan-Out」對應到傳統搜尋的「Single-Query Retrieval / One-Shot Retrieval」──它們分別代表「多查詢並行檢索」與「單查詢直接檢索」兩種不同的檢索策略。

如果想要更了解「檢索」(Retrieval)的概念,歡迎閱讀本篇文章《Retrieval(檢索)介紹:索引之後、排名之前的關鍵搜尋環節》,有很白話且詳細的解釋。

ChatGPT 有用 Query Fan-Out 嗎?

ChatGPT 的搜尋與 Google AI Mode Query Fan-Out 有相關性,下面一起討論。

ChatGPT o3 搜尋時,也會把我們的提問改寫多條子查詢並平行送出、或分批送出,同樣是「一查多投」。

這種做法本質上就是 query fan-out,但 ChatGPT 通常會說:「rewrite your query into one or more targeted queries(把查詢重寫成一個或多個更精準的查詢)」,不會使用「query fan-out」這個名詞。

ChatGPT 的搜尋流程

1. 判斷要不要上網找資料:模型先看你的問題是否需要即時或外部資訊。

2. 子查詢改寫:若需要,就把原句拆成多個更具體的關鍵字組合(可能同時考慮地理位置、時間範圍、同義詞等)。官方文件:「通常會重寫成一個或多個查詢再送給供應商」

3. 發送到第三方搜尋:這些子查詢可一次丟 Bing、Shopify 等不同索引,並行或序列地取回結果。

4. 把摘錄回灌給 o3:最後再走 RAG / 多步推理,把找到的段落、數據、圖片一併塞回模型,生成帶引用的回答。

延伸閱讀:《反向工程 ChatGPT SEO 策略:看透 AI 搜尋邏輯》

Query Fan-Out 對 SEO 的意義

從「關鍵字」轉向「主題/意圖」

AI Mode 在背景發射的子查詢涵蓋大量「隱含意圖」;要被選中,內容必須同時解答多個相關問題,而不僅是單一關鍵字

強調主題權威度(Topical Authority)

把一個主題的所有子問題都寫成高品質頁面,並利用內部連結串起,提升被選入 fan-out 子查詢的機率。

同時也建議把一個主題周邊的子主題都盡量想完,並且在內容中提供答案。

延伸閱讀:《AI Overviews(AI 摘要)介紹:AIO 是什麼?品牌要如何勝出?》

SEO 基礎原則仍重要

核心排名要素(內容品質、連結、技術健康)並未失效,只是 Query Fan-Out 把它們用在更多子查詢上。

內容結構與段落粒度

Fan-Out 會抽取「段落級」內容餵給 LLM。因此清晰的 H 標題、短段落、條列式重點,有助於被模型抓取並作為「引述片段」,文章架構要乾淨好懂,讓爬蟲容易理解。

總結

Google 2024 年底獲得了 Thematic Search 專利,專利內容與目前 AI Mode 使用的 query fan-out 技術相符,但「多查詢並行檢索」( parallel query retrieval)已成為整個 AI 搜尋產業的共同趨勢。

SEO 策略必須從關鍵字排名,走向對「隱含子查詢 / 主題網」的全面覆蓋與可抽取性優化,才能進一步提升能見度。

工商時間

如果你想要更系統化、更輕鬆的學好 SEO,推薦你參考我與知識衛星合作的 SEO 線上課程《SEO 排名攻略學:從產業分析到落地實戰,創造翻倍流量》。

這是我的 SEO 集大成之作,讓你從入門到精通,附贈實戰模板跟檢核表,讓你真正學好 SEO。