AI Token 介紹:Token 是什麼?理解 LLM、AI 的重要知識

讀懂 token,我們就掌握了生成式 AI 的出入、輸出的核心概念。

你或許沒聽過「Token」,Token 它正悄悄決定我們跟 AI 對話能說多少話、花多少錢,甚至左右一個專案一天能否跑完所有工作流程。

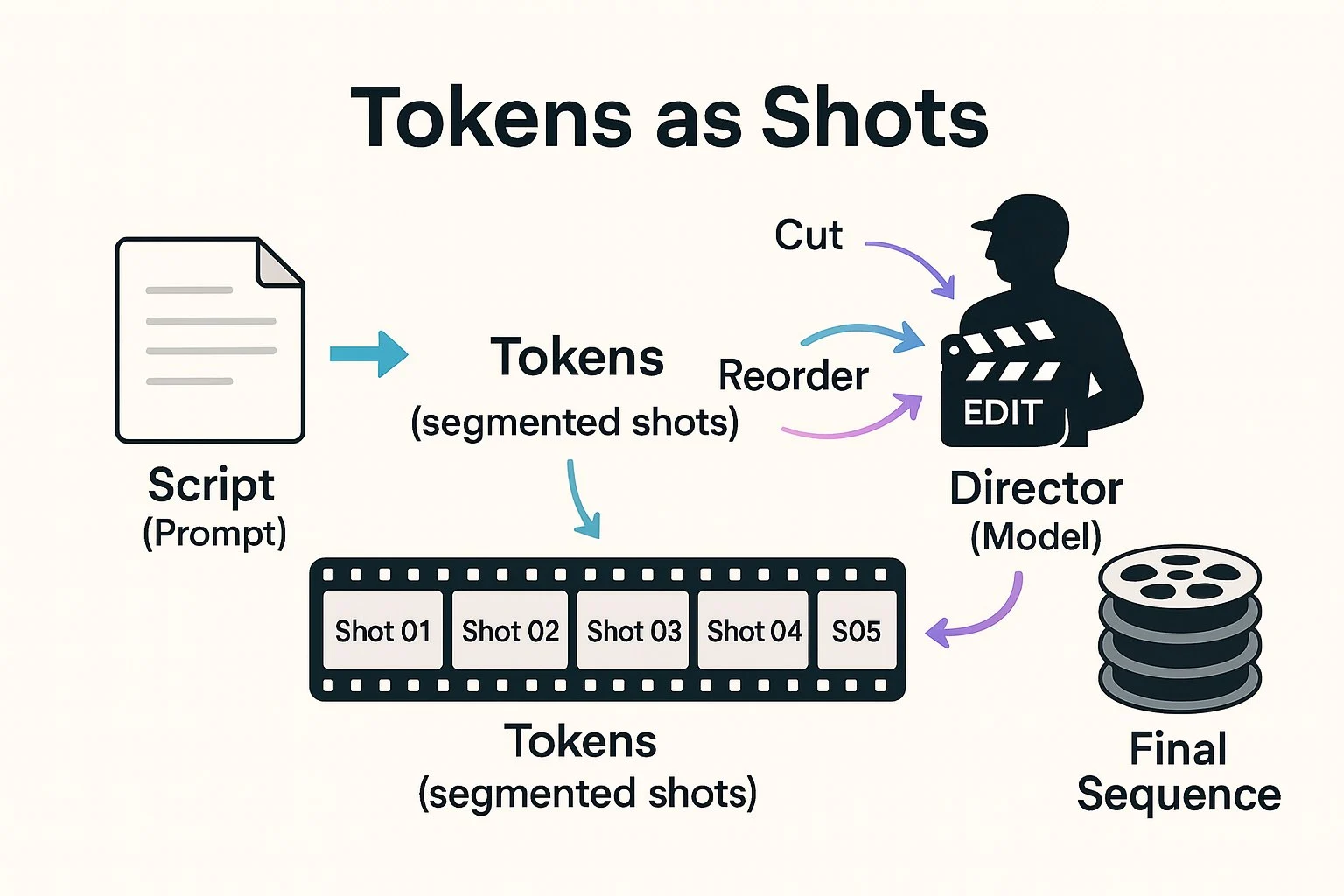

想像你把長篇小說塞進一台超級翻譯機:書頁會瞬間被裁成一顆顆「字粒」——這些字粒就是 token。

越多 token,機器就要翻得越久、收費越高;反之,精準切割、巧妙重組,既能壓低成本,也能讓 AI 模型更容易理解你的內容。

接下來,我們將帶你走進這顆看似微小、卻牽動算力、成本與創意邊界的「字粒宇宙」——讀懂 AI token,我們就掌握了生成式 AI 輸入、輸出的核心概念。

Token 是什麼?

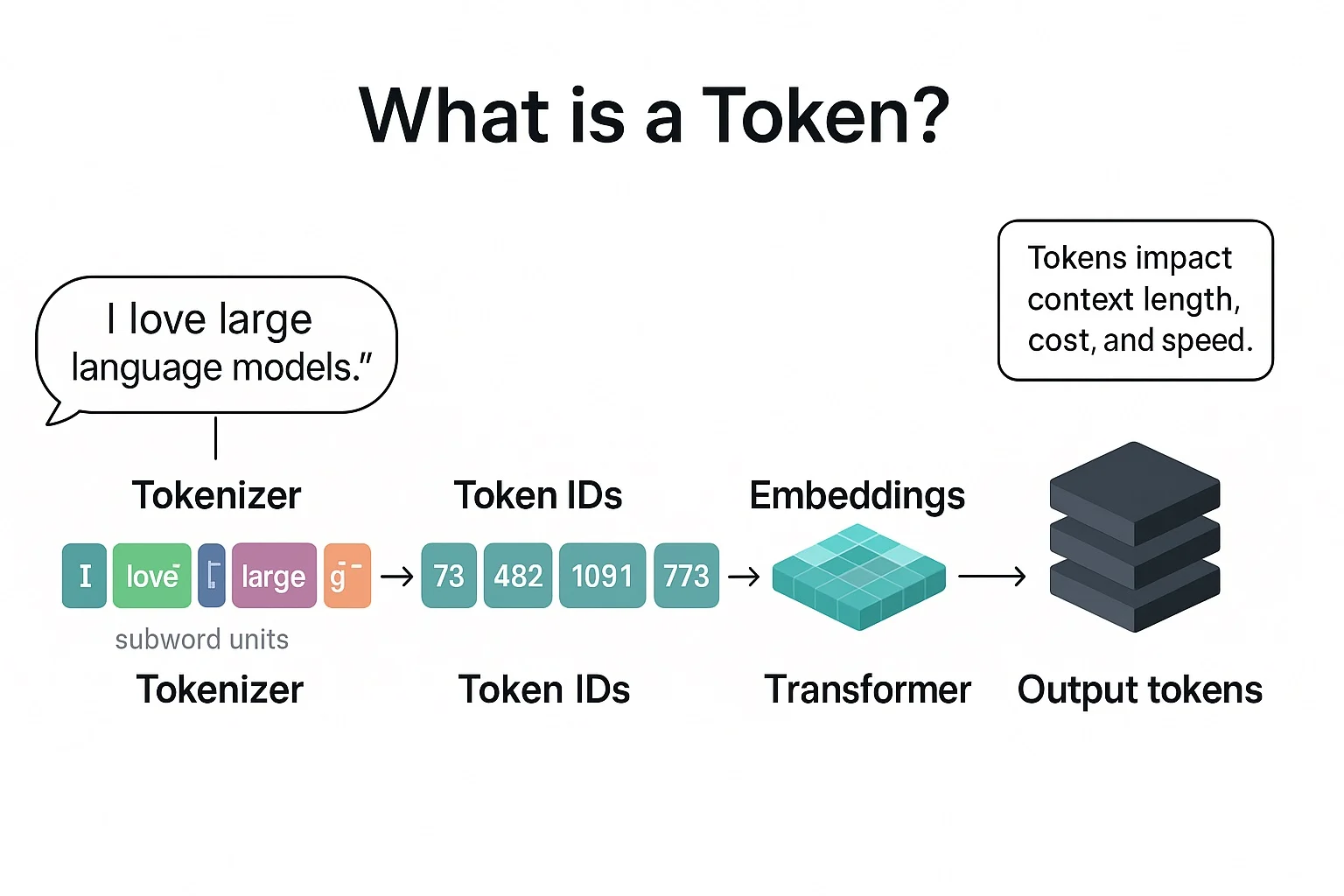

Token 就是模型看文字時用的「最小拼圖片」。

Token 不一定等於一個字或一個詞,而是把文字切成常見的字串片段(subword)、單一字元,或特定符號,再把它們變成數字給模型處理。

在 AI 裡,「Token」(符記)就是模型處理與產生文字時的基本計算單位——像樂高積木一樣,小到可以自由拼裝,大到能搭出整段文章。模型實際上看到的是這些「積木」的數值表示,再把它們轉成向量做學習與推理。

白話文舉例

電影分鏡:把整部片切成鏡頭(Token),導演(模型)讀腳本時就能快速瀏覽、剪輯、重組。

Token 大小長什麼樣?

英文裡,常見經驗值可以先抓 1 token 約等於 4 個字元、或約 3/4 個英文單字。

短詞如 “chat” 可能是一顆 token;較長單字則可能被切成多段。

中文沒有穩定的「每個字固定等於多少 token」公式。不同模型可能使用 BPE、SentencePiece 或其他近似子詞切分方法,實際比例會受標點、空格、中英混排、專有名詞與上下文影響,所以估算前最好用官方 tokenizer 或 count tokens 工具實測。

外部參考:OpenAI Counting tokens、OpenAI tiktoken 教學

為什麼一般人也需要理解 Token?

對多數人來說,理解 Token 不是為了研究 AI 技術、成為 AI 工程師,而是為了知道 AI 到底怎麼「讀懂」我們輸入的內容。

Token 會影響 AI 一次能看多少文字、回答可以寫多長,也會影響使用速度和費用。

當你知道 Token 是 AI 處理文字的基本單位後,就比較容易理解,為什麼有些問題明明很長,AI 卻抓不到重點。很多時候,不是 AI 突然變笨,而是輸入內容太亂、太長,或重要資訊被埋在後面。

對一般使用者來說,懂 Token 最大的好處,就是更知道怎麼把話說清楚。你會開始習慣把需求講短一點、重點放前面,讓 AI 更快理解,也讓回覆更接近你真正想要的結果。

這件事看起來很次要,但實際上很重要。

無論你是拿 AI 來寫文章、整理資料、做簡報,還是處理工作流程,理解 Token 都能幫助你更省時間、更省成本,也更容易把資訊灌入 AI。

為什麼要把文字切成 Token?

- 電腦只認得數字:把字拆成 token,再映射成 ID,才能丟進矩陣運算。

- 控制字典大小:若每個完整單字都給一個編號,字典會非常龐大;所以主流做法常採用子詞(subword)切分,把常見片段合併,不常見字再拆細。

- 處理生僻字與錯字:拆得夠細,模型就算沒見過整個單字,也可能靠片段推回大意。

Token 也等於「錢」

多數雲端 API 會把 input tokens 和 output tokens 當成主要計價單位:你送 100 token 的問題,模型回 300 token,總消耗就是 400 token。

但實際費用不只受輸入與輸出長度影響,還可能和 cached input、長上下文、batch / priority / flex 等服務模式,以及 web search、container 或其他工具功能有關。

Token 的費用

OpenAI(API:Text tokens,依模型與服務模式而異)

OpenAI 的價格頁會依模型與服務模式更新;如果文章重點是概念教學,比起把每個模型的單價寫死,更建議理解「不同模型有不同 input / cached input / output 定價」,並把最新數字交給官方 pricing 頁維護。

比較耐久的理解方式是:

- 高階模型通常單價較高,適合較複雜的推理、程式與長文件工作。

- mini / nano 類模型通常更便宜,適合大量分類、抽取與自動化流程。

- cached input 能降低重複上下文的成本。

- 長上下文、工具呼叫與不同服務層級,可能讓總成本再往上增加。

外部參考:OpenAI API Pricing、OpenAI Models

註:上圖可作為「不同模型、不同欄位會有不同 token 定價」的示意;實際數字請以官方價格頁為準。

關於更多不同模型的 Token 費用,可以參考:

Helicone – LLM API Pricing Calculator(helicone.ai/llm-cost)

- 覆蓋:標榜 300+ models、10+ providers

- 亮點:提供 API 端點可抓「每 1M tokens 的 input/output 成本」,也可用參數篩選 provider/model,甚至輸出 CSV(很適合你做自動更新到試算表或儀表板)。

- 網址:https://www.helicone.ai/llm-cost

透過《SEO 排名攻略學》獲得穩定的 SEO 流量與實戰經驗。

再搭配《AI SEO 流量變革》看懂 AI 搜尋趨勢,搶佔 AI 搜尋紅利。

Token 長度對比

先感覺一下「尺度感」:1 Token 大概是多少文字?

- 英文:1 token 常被粗略估成 0.75 個英文單字、4 個字元,也就是每 1,000 token 大約可容納 750 個英文單字。

- 中文:通常會比英文更耗 token,但沒有固定換算。實務上若只是抓尺度感,可以先把 1,000 token 理解成「大約數百個中文字」,精確值仍要看模型與內容。

對中文、日文與中英混排內容來說,token 長度變動通常比較大。若你要估價、切 chunk、做 RAG 或規劃上下文視窗,最穩妥的方法仍是拿一小段代表性文本先實測,再按比例推估整份文件。

簡易做法:

- 先挑一段代表性內容(例如 300–500 字)去 count tokens。

- 算出「每 100 字大約用掉多少 token」。

- 再把這個比例外推到全文,而不是直接套固定公式。

把長上下文 Token 轉成「紙本厚度」

不同模型的 context window 差異很大,從數十萬到百萬級 token 都可能出現;不能把某一代模型簡化成固定一個數字。

如果只是建立尺度感,可以先拿 256K token 當示例 來想像:

英文

- 若用 1 token ≈ 0.75 個英文單字粗估,256K token 約可對應 19 萬字左右的英文內容。

- 以市面常見 280–300 字/頁的排版來看,這已經是數百頁書稿等級的篇幅。

中文

- 中文沒有固定換算,但若內容以純文字敘述為主、標點規整、英文夾雜不多,256K token 通常已能容納一本中長篇書稿等級的文字量。

- 只要混入程式碼、表格、數字欄位、專有名詞或大量中英混排,實際可放進去的字數就會明顯下降。

延伸閱讀:《ChatGPT 怎麼用?ChatGPT 教學:帳號註冊、22 種技巧》

以 256K Token 為例,夠裝下一本什麼樣的書?

- 像《Harry Potter and the Order of the Phoenix》這類長篇英文小說,通常已接近或超過 256K token,實作上多半仍會分段餵給模型。

- 像《War and Peace》這種更長篇的作品,通常遠遠超過 256K token,更適合分批處理、摘要後再交叉引用。

為什麼 SEO 人員需要理解 Token?

在生成式搜尋時代,內容常常會先被切成片段,再進入檢索、排序、摘要與生成流程。理解 token,有助於你掌握內容的切分成本、摘要長度預算與大模型讀取方式。

但 token 並非是唯一決定因素。

內容能否被看見、被引用、被摘要,通常還和資訊品質、原創性、可抓取性、結構清晰度、實體訊號與來源可信度有關;也就是 GEO(Generative Engine Optimization),但它不是唯一或官方標準術語。

外部參考:Google Search Central:AI features and your website

延伸閱讀:《GEO 是什麼?與 SEO 有何差異?GEO 生意機會全面解析》

操作方向

- 關鍵資訊前置:把核心問題、主張與答案放在前面,降低被冗長前言稀釋的機率。

- 主題與結構清楚:用明確標題、清單、表格與段落層次,讓檢索與摘要都更穩定。

- 術語一致與可擷取性:品牌名、產品名、專有詞盡量維持一致,必要時搭配結構化資料,避免同一概念反覆換稱呼。

小結

在生成式搜尋時代,SEO 不只追關鍵字,也不只是「管理 token」。更務實的做法,是同時管理內容品質、資訊結構、可擷取性與成本意識;token 是其中一層,但不是全部。

透過《SEO 排名攻略學》獲得穩定的 SEO 流量與實戰經驗。

再搭配《AI SEO 流量變革》看懂 AI 搜尋趨勢,搶佔 AI 搜尋紅利。

AI Token 常見問題

AI 中的 token 是什麼?

在大型語言模型裡,token 就是模型讀取與產生文字時的基本單位。它可能是一個字母、一段字串、一部分單字、標點符號,或某些情況下的一整個詞。

模型會先把輸入切成一串 token,再進行運算,最後依序產生新的 token 作為輸出。

為什麼 AI 的 token 要花錢?

- 計算成本:每個輸入或輸出 token 都需要經過大量矩陣運算,背後是昂貴的 GPU / TPU、記憶體與電力。

- 基礎設施維護:服務商要維持資料中心、網路、模型升級、監控與安全機制。

- 定價方式:多數平台會把 token 當成主要計價單位,但快取、長上下文、工具呼叫與不同服務層級,也可能影響總費用。

簡單來說,token 收費本質上是在反映雲端推理與基礎設施成本;用得越多、佔用的計算資源越多,費用通常就越高。

ChatGPT 的 Token 怎麼計算?

OpenAI 的計價與長度限制都和 token 使用量有關,但不同 API 介面的欄位名稱可能不一樣。

在舊版 Chat Completions API,你常會看到 prompt_tokens、completion_tokens 與 total_tokens;在新版 Responses API,則常見 input_tokens、output_tokens 與 total_tokens。核心意思都一樣:統計輸入、輸出與總消耗量。

1 個 Token 大概多少字?

英文的經驗值通常抓 1 token ≈ 4 字元,或約 3/4 個英文單字。

中文沒有固定常數。若只是快速抓尺度感,可以先理解成「中文通常比英文更耗 token」,但真正估算時,還是以模型實測最準。

Token 是算力嗎?

Token 不是算力,而是模型處理語言時的基本單位,可能是一個字、詞的一部分、整個詞,或標點符號。

算力則是模型完成訓練或推理時消耗的計算資源,例如 GPU 性能、記憶體頻寬、運算量與延遲。兩者有關,但不是同一件事:token 數量越多,通常代表要處理的內容越長,推理時間與成本往往也會增加;但真正影響速度、價格與表現的,還有模型規模、架構設計、量化方式、批次大小與硬體效率。